[djang-vue연동] Vue.js 1. 설치부터 시작

[djang-vue연동] Vue.js 1. 설치부터 시작

0. 들어가면서 기본적으로 파이썬은 깔려있다고 가정하고 진행하겠다. 장고와 굳이 같은 폴더에서 할 필요가 없다. 다른 폴더를 만들고 진행해도 무방하다. 우선 가상환경을 만들고 가상환경으로 들어가자. $ virtualenv venv $ source venv/script/activate 1. Vue.js 설치 $ npm install -g @vue/cli 이 때 -g 를 적는 이유는 로컬 어디에서등 vue-cli를 요청 할 수 있도록 해주는 명령이라고 생각하면 된다. 그리고 설치 하는데 컴퓨터 사항에 따라 시간이 걸릴 수 있다는 점을 참고하자. vue-cli를 통해 vue.js 응용 프로그램을 만들 수 있다. 여기서 cli이란 해당 프레임워크의 명령어를 통해 컴퓨터가 입력받아 출력해 주는 명령어 인터페이스다..

자연어처리_TRANSFORMER

자연어처리_TRANSFORMER

0. 들어가면서 'Attention is All You Need'라는 말에서 알 수 있 듯, Transformer은 Attention으로만 이루어져 있다. 기계 번역(언어 번역)을 예로 깊숙한 곳으로 조금씩 들어가 보려고 한다. 1. Model 위의 그림을 보면 한 언어의 문장이 INPUT으로 넣으면 OUTPUT으로 다른 번역된 언어가 나오는 것을 알 수 있다. 그렇다면 조금 더 디테일 하게 들어가 보자. Transformer의 내부를 보면 ENCODERS와 DECODERS로 나눠져 있고, 그 둘 사이에 연결이 있는 것을 알 수 있다. encoding component는 encoders가 쌓여서 만들어져 있다. 그리고 decoder도 6개가 쌓여있는 것을 볼 수 있다. 인코더의 구조가 모두 동일하지만 가..

0. 들어가면서 텍스트 데이터를 학습한 모델의 크기는 단어의 개수에 영향을 받는다. RNN에서는 단어 개수에 비례하여 계산비용이 증가하기 때문에 word embedding 벡터의 종류가 제한이 생기는 문제가 발생한다. 이러한 문제를 해결하기 위해 단어를 한정적인 유닛으로 표현하는 Word Picece Model(WPM)이 생겼다. WPM은 언어에 상관 없이 모두 적용 할 수 있어서 특정 언어의 토크나이저를 만들지 않아도 되지만, 그렇다고 모든 데이터 분석에 적합한 것은 아니다. 수백만개의 단어를 포함하는 데이터를 표현하기 위해서는 bag of words model에서는 단어 개수 만큼의 embedding vector를 학습하기 때문에 단어의 개수가 많을 수록 차원이 커지고 모델이 무거워진다. 이러한 문제..

자연어처리_BERT 기초개념(완전 초보용)

자연어처리_BERT 기초개념(완전 초보용)

0. 들어가면서 기본적인 자연어 처리 흐름을 알기 위해서는 아래의 블로그에서 확인을 하자. han-py.tistory.com/249?category=942088 자연어처리 개념(RNN에서 BERT) 1. RNN (Recurrent Neural Network) RNN이 왜나왔을까? 기존 신경망은 연속적인 시퀀스를 처리하기 어렵다. 따라서 입력의 순서가 중요한 분야인 자연어 처리, 음성인식, 주식, 날씨, 음악 같은 부분에서 한 han-py.tistory.com 1. BERT(Bi-directional Encoder Representations from Transformers) 기본 개념 기본적으로 Pre-trained BERT에 위에 classification layer를 하나 추가해주면 다양한 NLP를 ..

자연어처리 발전흐름(RNN에서 BERT)

자연어처리 발전흐름(RNN에서 BERT)

1. RNN (Recurrent Neural Network) RNN이 왜나왔을까? 기존 신경망은 연속적인 시퀀스를 처리하기 어렵다. 따라서 입력의 순서가 중요한 분야인 자연어 처리, 음성인식, 주식, 날씨, 음악 같은 부분에서 한계가 들어난다. RNN이란 아래의 그림과 같이 이전 출력값이 현재 결과에 영향을 미친다. 위 그림에서 식을 보면 순환 w와 입력 U의 두 개의 가중치가 존재하는것을 알 수 있다. 물론 입출력도 자유롭다는 것을 알 수 있다. 2. LSTM(Long Short Term Memory) LSTM이 나왔는다는 RNN의 문제점이 있다는 것을 알 수 있다. 아래의 그림을 보면 처음 입력의 정보가 뒤로 갈수록 사라진다는 것을 알 수 있다. LSTM의 목적은 입력 중 핵심적인 정보를 잊어버리지 ..

tensorflow_CNN의 기본연산 Pooling 구현하기_tf.keras.layers.MaxPool2D

tensorflow_CNN의 기본연산 Pooling 구현하기_tf.keras.layers.MaxPool2D

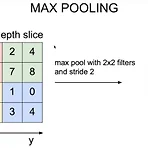

0. 들어가면서 합성곱 신경망(CNN)인 Convolution Neural Network의 기본 연산중 하나인 Pooling 연산에 대해 알아보자. 아래의 블로그를 통해 Convolution 연산에 대해 알아 보고 동작 원리도 알아 보았다. han-py.tistory.com/230 han-py.tistory.com/231 정리하면 Convolution 연산 후에 Activation Function(ReLU)를 활용해 -1를 0으로 바꿔주는 것 까지 알아 보았다. 이렇게 Convolution layer 하나를 구성한 이 후에 출력값(output feature)을 이용해서 다시 Convolution layer를 하나 구성해서 입력으로 넣어 주거나 Pooling layer를 넣어서 Pooling layer에 ..

tensorflow_tf.keras.layer.Conv2D, CNN 기초 코딩해보기

tensorflow_tf.keras.layer.Conv2D, CNN 기초 코딩해보기

0. 들어가면서 cnn의 기초는 아래의 링크를 따라가자. han-py.tistory.com/230 지금 글적다가 다 날라갔다... 인내심을 가지고 다시 적어보겠다. 일단 관련 깃헙 파일에 들어가서 tf.keras.layer.Conv2D를 찾아보면 아래와 같다. 사실 이렇게 생겼구나! 만 보고 넘어가면 된다. class Conv2DTranspose(Conv2D): """Transposed convolution layer (sometimes called Deconvolution). The need for transposed convolutions generally arises from the desire to use a transformation going in the opposite direction of..

0. 들어가면서 이 부분에서는 JWT를 쓰는 당위성에 대해 적어 보겠다. 코드만 보려면 긴 글을 읽지 않아도 된다. 일단 JWT를 왜 쓰는가에 대해 간단히 적어보겠다. 우리는 로그인, 로그아웃, 즉, 사용자의 인증정보를 관리하기 위해 검색을 하고 있는 것이다. 사용자 인증 정보는 세션 기반 인증과 토큰 기반 인증이 있는데, 세션 기반 인증은 유저가 로그인을 하면 서버 쪽에서 로그인 중이라고 기억을 하고 있는 것이다. 이렇게 되면 로그인 유저가 많아아 질 경우 성능에 무리가 간다. 그러면 토큰은 이러한 문제점이 없을까? 토큰은 로그인 시 유저에게 토큰을 발급해준다. 즉, 서버쪽에서 저장을 하지 않기 때문에 서버 확장 시 매우 용이해진다. 왜냐하면 서버를 확장하여 분산되어 있어도 토큰을 서버에 요청을 하면 ..

- Total

- Today

- Yesterday

- typescript

- mongoDB

- django

- next.config.js

- Express

- useState

- UserCreationForm

- useHistory 안됨

- vuejs

- Python

- NextJS

- error:0308010C:digital envelope routines::unsupported

- nodejs

- login

- react autoFocus

- TensorFlow

- Queue

- logout

- 자료구조

- JavaScript

- DFS

- pandas

- Vue

- nextjs autoFocus

- 자연어처리

- react

- read_csv

- BFS

- Deque

- 클라우데라

| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | 6 | 7 |

| 8 | 9 | 10 | 11 | 12 | 13 | 14 |

| 15 | 16 | 17 | 18 | 19 | 20 | 21 |

| 22 | 23 | 24 | 25 | 26 | 27 | 28 |

| 29 | 30 | 31 |